#

1D Code

Type de code-barres qui code les informations selon une disposition linéaire de lignes parallèles. Ces codes sont lus à l’aide d’une seule ligne de balayage, généralement avec un laser ou un scanner basé sur l’image. Les données sont décodées en mesurant les variations d’épaisseur et d’espacement des lignes.

1D Imaging

Implique la capture et l’analyse de données dans une seule dimension. Dans le contexte de la vision industrielle, cela signifie généralement collecter des données sur une seule ligne ou un seul axe. Ceci est souvent utilisé pour des tâches telles que la lecture de codes-barres, où un laser ou une caméra capture des informations dans un format linéaire.

2D Code

Un code 2D est un motif codant des informations sur deux dimensions à l’aide d’une matrice de motifs carrés ou rectangulaires, de points ou de formes géométriques.

2D Code

Un code 2D est un motif codant des informations sur deux dimensions à l’aide d’une matrice de motifs carrés ou rectangulaires, de points ou de formes géométriques.

Les codes 2D sont plus complexe que les codes 1D, et nécessitent une technologie plus avancée pour l’acquisition et le décodage. Pour lire les codes 2D, les scanners doivent capturer et interpréter l’intégralité du motif représenté par le code-barres, au lieu d’une seule ligne.

Les codes 2D peuvent stocker des données horizontalement et verticalement, ce qui leur permet de stocker plus d’informations dans un espace plus petit. Quelques exemples de codes 2D incluent les QR codes et les codes DataMatrix.

2D Imaging

Implique la capture et l’analyse de données en deux dimensions, représentant généralement une zone ou un plan. Cela s’apparente davantage à la photographie ou à la vidéo traditionnelle, où une image ou une vidéo est capturée dans un format rectangulaire, contenant à la fois des informations sur la largeur et la hauteur.

Quelques exemples de ce que les capteurs 2D peuvent faire : cliquez ici.

3D Imaging

Fait référence à la technologie et aux processus utilisés pour capturer, traiter et analyser les informations tridimensionnelles d’une scène ou d’un objet. Contrairement à l’imagerie 2D traditionnelle, qui produit des images plates, les systèmes d’imagerie 3D fournissent des informations sur la profondeur, permettant aux machines de percevoir et de comprendre les caractéristiques spatiales des objets de manière plus complète.

Pour découvrir ce que vous pouvez réaliser avec les capteurs 3D, cliquez ici.

Aa

Aberration

La déviation ou la distorsion des rayons lumineux lorsqu’ils traversent un système optique, tel qu’une lentille ou un miroir. En vision industrielle, cela concerne l’impact sur la qualité et la précision de l’image.

Absorption

Processus par lequel la lumière frappant une surface est absorbée, empêchant sa réflexion ou sa transmission. Ceci peut être remarqué sur les plastiques opaques de couleur claire et doit être pris en compte lors du choix de l’éclairage pour votre application.

Algorithme

Un ensemble d’instructions et de calculs utilisés par les ordinateurs pour atteindre des objectifs. Dans l’automatisation industrielle, les algorithmes analysent les données des capteurs, des scanners et des caméras pour identifier les inefficacités et suggérer des améliorations.

Alphanumeric Code / Code alphanumérique

Type de code combinant des chiffres, des lettres, des symboles et des signes de ponctuation pour coder les informations sur le produit. La séquence de ces caractères véhicule des informations spécifiques, permettant de représenter des données structurées. Cette forme de codage est couramment utilisée dans les systèmes de codes-barres.

Ambient Light / Lumière ambiante

La lumière ambiante fait référence à toute la lumière provenant de sources autres que la source lumineuse intégrée au système de vision industrielle, comme la lumière du soleil ou les luminaires intérieurs.

AOI

Automated Optical Inspection (Inspection Optique Automatisée) utilisant l’imagerie optique. Les systèmes AOI s’appuient sur des caméras et des algorithmes de traitement d’image pour analyser diverses caractéristiques visuelles d’un objet.

Aperture / Ouverture

Fait référence à une ouverture réglable dans un système optique, tel qu’une caméra ou un objectif, qui contrôle la quantité de lumière entrant dans le système.

Aperture / Ouverture

Fait référence à une ouverture réglable dans un système optique, tel qu’une caméra ou un objectif, qui contrôle la quantité de lumière entrant dans le système.

Il joue un rôle crucial dans la régulation de l’exposition d’un capteur d’image à la lumière entrante. En ajustant la taille de l’ouverture, l’opérateur peut influencer la profondeur de champ de vision et contrôler la quantité de lumière atteignant le capteur.

Une plus grande ouverture laisse passer plus de lumière et entraîne une profondeur de champ plus faible, tandis qu’une ouverture plus petite réduit la lumière et augmente la profondeur de champ. C’est la raison pour laquelle TPL Vision fabrique des éclairages avec mode strobe OverDrive permettant d’augmenter la luminosité de l’éclairage.

Area Scan Camera / Caméra à balayage de surfaces

Un dispositif d’imagerie équipé de lignes et de colonnes de pixels, disposées en réseau pour générer une image 2D. Par rapport aux caméras à balayage linéaire (line scan), les caméras à balayage de surfaces sont plus polyvalentes et plus simples à installer et à régler. Elles sont plus adaptées aux applications où l’objet est statique.

Artificial Intelligence (AI) / Intelligence artificielle (IA)

Capacité d’un ordinateur numérique ou d’un robot contrôlé par ordinateur à exécuter des tâches généralement associées à la prise de décision humaine.

Dans l’automatisation des usines, les algorithmes d’IA utilisent des technologies telles que la reconnaissance d’images et le traitement du langage naturel pour réduire les erreurs humaines et anticiper les défis de production.

Aspect Ratio / Ratio d’aspect

Le ratio d’aspect d’une image est déterminé en divisant sa largeur affichée par sa hauteur, généralement représentée par « x : y ».

Par exemple, une caméra de 1,2 mégapixels au format 4:3 aura 1 280 x 960 pixels sur le capteur.

Bb

Backlighting / Rétroéclairage

Placement d’une source de lumière derrière un objet en cours d’imagerie ou d’inspection.

Cette méthode d’éclairage est couramment utilisée pour créer une silhouette très contrastée des bords de l’objet. Contrairement à un éclairage directif, le rétroéclairage illumine l’objet du côté opposé de la caméra, mettant en évidence les défauts de surface, les imperfections ou les caractéristiques qui pourraient être difficiles à éclairer avec d’autres méthodes.

Découvrez notre gamme de rétroéclairages ici.

Bandpass Filter / Filtre passe-bande

Dispositif optique utilisé pour laisser passer une plage spécifique de longueurs d’onde tout en bloquant d’autres longueurs d’onde.

Les filtres passe-bande ne laissent passer qu’une étroite bande de lumière, permettant à l’appareil photo de capturer des images avec un contraste et une visibilité améliorés sur certaines caractéristiques. Ces filtres sont utiles dans les applications où des couleurs ou des longueurs d’onde spécifiques de lumière doivent être isolées pour des tâches d’inspection précise, de reconnaissance d’objets ou d’analyse d’images.

Barcode / Code-barres

Type d’image qui code les données dans une représentation graphique qui peut être lue et interprétée par des lecteurs de codes-barres ou des caméras de vision industrielle.

Bayer Conversion / Matrice de Bayer

Processus de transformation de données, acquises à partir d’une matrice Bayer ou d’un réseau de filtres de couleur, en couleurs RVB.

Bar Lighting / Éclairage barre

Également appelé éclairage linéaire, il s’agit d’une technique d’éclairage qui consiste à utiliser un réseau de sources lumineuses fournissant un éclairage directionnel.

Parcourez notre gamme de barres d’éclairage ici.

BGA

La matrice de billes (Ball Grid Array ou BGA) est un type de boîtier de circuit intégré, destiné à être soudé sur un circuit imprimé.

Big Data

Technologies qui consolident de vastes ensembles de données provenant de plusieurs sources et utilisent des outils d’analyse pour générer des informations uniques. L’intelligence artificielle s’appuie sur le Big Data pour imiter la prise de décision humaine et produire des prévisions précises.

Bit Depth / Profondeur de couleur

Nombre de bits utilisés pour représenter les informations de couleur ou d’échelle de gris de chaque pixel d’une image. Il détermine la gamme de couleurs ou de nuances de gris qui peuvent être capturées et affichées par le système d’imagerie.

- Pour les images en niveaux de gris, la profondeur de bits indique le nombre de niveaux de gris différents qui peuvent être représentés. Par exemple, une image en niveaux de gris 8 bits comporte 2 ^ 8 (256) nuances de gris possibles, allant du noir (0) au blanc (255).

- Dans le cas d’images couleur, la profondeur de bits est généralement attribuée à chaque canal de couleur (par exemple rouge, vert et bleu) individuellement. Par exemple, une image couleur 8 bits possède 256 niveaux d’intensité pour chaque canal de couleur, ce qui donne un total de plus de 16 millions de couleurs possibles (256^3).

Blob Analysis / Analyse de taches

Identifier et analyser des groupes de pixels connectés qui forment des objets distincts dans une image. Ces régions, souvent appelées « blobs », représentent des objets ou des zones d’intérêt partageant des propriétés communes, telles que la couleur, l’intensité, la texture ou la forme.

Bright Field Lighting / Éclairage directif

Fait référence à une configuration d’éclairage dans laquelle la source de lumière est positionnée pour éclairer l’objet examiné du même côté que la caméra ou le capteur d’imagerie.

L’éclairage directif est couramment utilisé pour capturer les caractéristiques et les couleurs détaillées des surfaces. Il est plus efficace lorsqu’il est appliqué à des objets présentant des caractéristiques de surface distinctes, des couleurs bien définies et des formes simples.

Cc

Camera Triggering / Déclenchement de la caméra

Processus de contrôle externe lorsqu’une caméra capture une image, souvent synchronisée avec des événements externes, comme le mouvement d’un objet sur un tapis roulant.

Charge-Coupled Device (CCD) / Capteur CCD

Les capteurs CCD (Charge-Coupled Device) et CMOS (Complementary Metal-Oxide-Semiconductor) sont deux types de capteurs d’image utilisés dans les caméras numériques, y compris celles utilisées dans les systèmes de vision industrielle.

Le capteur CCD est une technologie plus ancienne et plus traditionnelle pour capturer des images numériques. Les capteurs CCD offrent généralement une qualité d’image supérieure, une meilleure plage dynamique et des niveaux de bruit plus faibles, en particulier dans des conditions de faible luminosité. Cependant, ils sont plus coûteux à fabriquer et consomment plus d’énergie.

Complementary Metal-Oxide-Semiconductor / Capteur CMOS

Les capteurs CMOS (Complementary Metal-Oxide-Semiconductor) et CCD (Charge-Coupled Device) sont deux types de capteurs d’image utilisés dans les caméras numériques, y compris celles utilisées dans les systèmes de vision industrielle.

Les capteurs d’images CMOS (Complementary Metal-Oxide-Semiconductor) sont plus récents et sont devenus de plus en plus populaires. Les capteurs CMOS utilisent un processus de fabrication différent qui permet à chaque pixel d’avoir son propre amplificateur individuel, ce qui facilite l’intégration d’autres circuits sur la même puce. Les capteurs CMOS sont généralement plus économes en énergie et plus rentables à produire, ce qui a contribué à leur adoption généralisée dans l’électronique grand public et les applications industrielles.

C-mount

Objectifs interchangeables qui utilisent un filetage standard à monture C pour se fixer aux caméras de vision industrielle. Les objectifs à monture C permettent aux utilisateurs de basculer facilement entre différentes longueurs focales et configurations optiques pour s’adapter aux diverses exigences d’imagerie et distances de travail. La monture C est dotée d’une monture filetée de 1 pouce de diamètre avec un pas de 32 filetages par pouce (1″-32UN).

Collimated Light / Éclairage collimaté

Éclairage composé de rayons parallèles, avec une divergence ou une convergence minimale. La lumière est émise de manière à ce que ses rayons soient presque parallèles et ne se propagent pas de manière significative au cours de leur déplacement, ce qui la rend parfaite pour les applications de mesure précise ou de détection de caractéristiques.

Ce type d’éclairage peut être associé à une caméra et un objectif télécentrique.

Colour Temperature / Température de couleur

Caractéristique des sources de lumière blanche faisant référence à l’apparence de la couleur de la lumière qu’elles émettent, généralement mesurée en Kelvin (K).

Continuous Working / Mode continu

Une configuration d’éclairage qui fournit une lumière constante et ininterrompue pendant des périodes prolongées.

Contraste

La variation de l’intensité ou de la couleur des pixels entre différentes régions ou objets au sein d’une image. Un contraste élevé indique des différences distinctes dans les valeurs de pixels, ce qui permet aux systèmes de vision industrielle de détecter et d’analyser plus facilement les objets avec précision.

CS-mount

Monture C, avec un point focal 5 mm plus court. La distance plus courte permet au capteur de la caméra d’être plus proche de l’objectif, ce qui le rend plus adapté à une utilisation avec des capteurs d’image plus petits.

CTF (Fonction de transfert de contraste)

Fonction de transfert de contraste, une mesure quantitative utilisée pour décrire les performances d’imagerie d’un système optique. Il évalue la capacité du système à préserver le contraste d’une image, en particulier lors de l’imagerie de motifs très contrastés ou de détails fins.

Dd

Daisy-Chain / Chaînage en marguerite

Mode de fonctionnement dans lequel plusieurs appareils ou composants, tels que des caméras, des solutions d’éclairage ou des capteurs, sont reliés entre eux de manière séquentielle à l’aide d’une seule ligne de communication. Chaque unité est reliée aux unités précédentes et suivantes via un seul câble, ce qui permet le contrôle centralisé de toutes les unités à partir d’un seul point de contrôle. Dans les applications nécessitant un éclairage synchronisé, la connexion Daisy Chain garantit que toutes les unités d’éclairage reçoivent des signaux de commande en même temps.

Dark Field Lighting / Éclairage Dark Field

Technique d’éclairage qui met en évidence les irrégularités ou les défauts de surface en dirigeant la lumière selon un angle très faible (par rapport à l’axe optique de la caméra), faisant ressortir distinctement les éléments sur un fond uniforme et sombre.

Cette technique est idéale pour mettre en évidence des rayures, des particules ou des irrégularités de surface sur des objets brillants ou transparents.

Parcourez notre gamme d’éclairages Low Angle ici.

Data Matrix

Un code-barres bidimensionnel qui code les informations sous la forme de carrés noirs et blancs disposés selon un motif en grille. Il est utilisé pour stocker et récupérer des données telles que des informations sur les produits, des numéros de série et d’autres ensembles de données dans un format compact. Son design est généralement plus simple qu’un QR code.

Deep Learning

Une technologie d’intelligence artificielle (IA) conçue pour automatiser des applications complexes et personnalisées. Un sous-ensemble du Machine Learning.

Le traitement s’effectue via une unité de traitement graphique (GPU), qui permet aux utilisateurs de créer des réseaux neuronaux sophistiqués à partir de grands ensembles d’images détaillées. En tirant parti de ces réseaux neuronaux, le Deep Learning peut analyser efficacement de vastes ensembles d’images et détecter des défauts subtils et variables afin de différencier les anomalies acceptables et inacceptables.

/ Profondeur de champ

Distance à laquelle les objets d’une scène apparaissent suffisamment nets dans l’image capturée. Une grande profondeur de champ signifie qu’une plage de distances plus large est mise au point, tandis qu’une faible profondeur de champ entraîne une plage de distances plus étroite.

Diaphragme

Fait référence au mécanisme d’ouverture réglable dans un objectif qui contrôle la quantité de lumière entrant dans la caméra. Il est utilisé pour ajuster la taille de l’ouverture de l’objectif, appelée ouverture, qui affecte directement la profondeur de champ et la quantité de lumière atteignant le capteur.

Diffuse Lighting / Éclairage diffus

Éclairage qui fournit une lumière uniforme et non directionnelle pour minimiser les ombres et les reflets.

Disturbance / Perturbation

Variation, interférence ou changement indésirable ou involontaire dans l’environnement d’imagerie pouvant avoir un impact négatif sur l’évaluation de l’image.

Dome Lighting / Éclairage dôme

Souvent appelé « ciel diffus », l’éclairage dôme est une technique d’éclairage populaire en vision industrielle en raison de l’éclairage diffus et uniforme qu’il produit. Les dômes se présentent sous deux formes, soit plat avec un trou dédié à la caméra au centre pour éclairer de grandes zones, soit dans un boîtier rond « classique », doté de leds éclairant une surface réfléchissante interne.

Couramment utilisé pour inspecter des surfaces brillantes ou courbes, l’éclairage dôme peut aider à minimiser les ombres, à réduire les reflets et à améliorer les détails de la surface.

Retrouvez notre gamme de dômes classiques et de dômes plats ici.

Marquage par micro-percussion

Type de procédure de marquage qui consiste à produire une séquence de petits points rapprochés, formant un code matriciel de données sur la surface du matériau. Cette méthode est couramment utilisée dans les applications industrielles pour l’étiquetage permanent, l’identification et la traçabilité de divers objets, tels que le métal, le plastique et d’autres matériaux durs.

Duty Cycle / Rapport Cyclique

Fait référence au rapport entre la durée pendant laquelle un appareil ou un composant est actif ou allumé et la durée totale d’un cycle complet. En éclairage, il s’agit du pourcentage de temps pendant lequel une source d’éclairage émet de la lumière au cours d’un cycle opérationnel.

Lors du fonctionnement d’un éclairage en mode OverDrive, le cycle de service maximum spécifié pour l’allumage et l’extinction de l’éclairage doit être respecté pour éviter d’endommager le produit.

Dynamic Range / Plage dynamique

Fait référence à la capacité de la caméra à capturer une large gamme de niveaux de luminosité dans une image, des ombres les plus sombres aux reflets les plus clairs.

Ee

Edge Detection / Détection des bords

Processus d’identification et de mise en évidence des limites ou des transitions nettes entre différents objets ou régions d’une image. Elle vise à localiser l’emplacement de changements de contraste significatifs, correspondant souvent aux bords ou aux contours des objets.

Edge Learning / Apprentissage en périphérie

Un sous-ensemble du Machine Learning. Le traitement s’effectue sur l’appareil, ou « en périphérie », à l’aide d’un ensemble d’algorithmes pré-entraînés. Cette technologie, simple à calibrer, nécessite des ensembles d’images plus petits (5 à 10 images) et des périodes de formation plus courtes que les solutions traditionnelles basées sur le Deep Learning.

Exposure Time / Temps d’exposition

Durée pendant laquelle le capteur d’image de la caméra est exposé à la lumière lors de la capture d’une image.

Un temps d’exposition plus long laisse entrer plus de lumière dans le capteur mais peut conduire à des images floues.

Ff

Feature Extraction / Extraction de caractéristiques

Processus d’identification et d’isolement de modèles, de formes ou de caractéristiques spécifiques à partir d’images brutes.

L’extraction de caractéristiques cherche à capturer des informations pertinentes tout en supprimant les détails non pertinents ou redondants. Ce processus s’apparente à la façon dont le système visuel humain se concentre sur les aspects essentiels d’une image tout en ignorant le bruit de fond ou les éléments non pertinents. Les algorithmes d’extraction de caractéristiques mettent en évidence les aspects distinctifs de l’image, tels que les bords, les coins, les textures, les formes ou les variations de couleurs, qui peuvent contenir des informations vitales pour une analyse ultérieure.

Feature Matching / Correspondance de caractéristiques

Processus dans lequel des algorithmes identifient et font correspondre des caractéristiques ou des modèles spécifiques dans les images pour déterminer les correspondances entre différentes vues ou scènes. Ce processus est souvent utilisé en robotique, en navigation et en réalité augmentée.

Feedback Loop / Boucle de rétroaction

Le cycle répété durant lequel les algorithmes de machine learning améliorent continuellement leurs performances.

Flange Distance / Distance de la bride

Distance entre la bride de montage (« l’anneau métallique » dans la partie arrière de l’objectif) et le détecteur de la caméra.

F-Number, F#

Le rapport entre la distance focale d’un objectif et le diamètre de son ouverture. Il représente la taille de l’ouverture par rapport à la distance focale de l’objectif et joue un rôle important dans le contrôle de la quantité de lumière qui pénètre dans la caméra.

Focal Length / Distance focale

Distance entre le centre optique de l’objectif et le capteur d’image, ou le point où les rayons lumineux convergent pour former une image focalisée. Elle détermine le grossissement et le champ de vision de l’image capturée.

Une distance focale plus courte donne un champ de vision plus large mais un grossissement potentiellement plus faible, tandis qu’une distance focale plus longue offre un champ de vision plus étroit avec un potentiel de grossissement plus important. Les objectifs à focale la plus courte ont un effet « fish-eye » avec beaucoup de distorsion optique.

Frame Rate / Fréquence d’images

Nombre d’images individuelles que la caméra peut capturer par seconde, mesuré en images par seconde (ips). Une fréquence d’images plus élevée permet à la caméra de capturer des objets en mouvement rapide.

Gg

Global Shutter / Obturateur global

Type de technologie de capteur de caméra qui permet à tous les pixels de l’image d’être exposés simultanément. Un capteur à obturateur global lit une image entière en même temps, figeant simultanément le mouvement des objets dans la scène.

Les caméras à obturateur global sont particulièrement adaptées aux applications impliquant des objets en mouvement ou des scènes rapides, car elles fournissent des images précises et sans distorsion d’environnements dynamiques.

Hh

HMI (Human-Machine Interface / Interface Homme-Machine)

Interface qui permet aux opérateurs humains d’interagir et de communiquer avec les systèmes de vision industrielle, généralement via des interfaces graphiques.

Homogénéité

La distribution uniforme de l’intensité lumineuse, dans laquelle l’intensité de la lumière est constante sur tout le champ de vision.

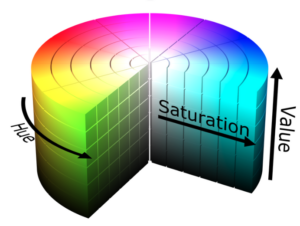

HSV Colour Space / Espace colorimétrique HSV

Un modèle colorimétrique qui représente les couleurs à l’aide de trois composants : teinte (H), saturation (S) et valeur (V).

- Teinte : information de couleur pure allant de 0° à 360° sur une roue chromatique. Définit la longueur d’onde dominante de la couleur.

- Saturation : l’intensité ou la pureté de la couleur, allant de 0 (gris ou insaturé) à 100 (saturation complète des couleurs).

- Valeur : la luminosité de la couleur, allant de 0 (noir) à 100 (blanc).

Hyperspectral Imaging / Imagerie hyperspectrale

Capturer et analyser des images dans une multitude de bandes spectrales étroites et contiguës, permettant l’identification de matériaux en fonction de leurs signatures spectrales uniques.

Contrairement à l’imagerie traditionnelle, qui enregistre les informations de couleur généralement dans trois bandes (rouge, vert, bleu), l’imagerie hyperspectrale divise le spectre électromagnétique en de nombreuses bandes étroites, permettant d’acquérir des informations spectrales très détaillées pour chaque pixel d’une image.

Ii

Illuminance / Éclairement

Mesurée en lux (lx), c’est la quantité du flux lumineux (lumière) sur une unité de surface.

Infrared Light / Lumière infrarouge

La lumière infrarouge fait référence à un rayonnement électromagnétique dont les longueurs d’onde sont plus longues que celles de la lumière visible, allant généralement d’environ 700 nanomètres (nm) à 1 millimètre (mm).

La lumière infrarouge est utilisée en vision industrielle à diverses fins, notamment pour améliorer la visibilité dans des conditions de faible luminosité ou dans l’obscurité totale, détecter les variations de température dans l’imagerie thermique et permettre la détection de matériaux ou d’objets spécifiques en fonction de leurs signatures infrarouges uniques.

L’éclairage IR est invisible à l’œil humain, il est souvent utilisé dans les applications où des personnes opèrent à proximité. La lumière IR peut également se transmettre à travers des matériaux tels que les plastiques opaques et les bandes transporteuses. Cela est dû au fait que les longueurs d’onde plus longues interagissent moins avec le matériau qu’elles traversent. Remarque : certaines caméras sont moins sensibles à la lumière IR (voir plage spectrale).

Internet of Things (IoT) / Internet des objets

Réseau d’objets physiques connectés à Internet et intégrés à des capteurs qui collectent et échangent des données en temps réel avec d’autres appareils et systèmes via Internet. Cela permet aux appareils d’être surveillés, contrôlés et coordonnés à distance, sans intervention humaine directe.

Image Evaluation / Évaluation des images

Processus d’analyse et d’évaluation du contenu et des attributs des images capturées par des caméras ou des capteurs.

Image Processing / Traitement d’image

Technique numérique qui consiste à manipuler et analyser des images numériques pour extraire des informations utiles ou effectuer des tâches spécifiques. Il englobe un large éventail d’algorithmes et de méthodes pour modifier, filtrer et analyser les images afin d’obtenir les résultats souhaités.

Ll

Led

Light Emitting Diode / Diode électro-luminescente Couramment utilisé en vision industrielle en raison de leurs nombreux avantages, notamment le contrôle d’intensité, une faible consommation d’énergie et une longue durée de vie.

Lens / Objectif

Composant optique utilisé dans les systèmes de vision industrielle pour focaliser et manipuler la lumière. Les objectifs sont essentiels pour capturer et former des images d’objets claires à des fins d’analyse et d’inspection.

Ils fonctionnent en courbant ou en réfractant les rayons lumineux pour les faire converger vers un capteur d’image. Les objectifs peuvent contrôler la profondeur de champ, le grossissement et corriger les aberrations optiques.

Balayage linéaire

Méthode utilisée en vision industrielle pour capturer des images ligne par ligne, au lieu de capturer l’image entière en une seule fois. Une caméra Line Scan contient une seule rangée de pixels disposés en réseau linéaire et capture chaque ligne de l’image lorsqu’elle se déplace dans le champ de vision.

Les caméras à balayage linéaire sont couramment utilisées dans les applications dans lesquelles les objets se déplacent rapidement ou lorsqu’une imagerie haute vitesse et haute résolution est requise, comme pour l’inspection de bandes, l’inspection de surfaces et le contrôle de la qualité d’impression. Ces applications nécessitent également un éclairage puissant et uniforme.

Longpass Filter / Filtre passe-haut

Dispositif optique utilisé pour transmettre des longueurs d’onde de lumière plus longues (inférieures) qu’une longueur d’onde de coupure spécifiée, tout en bloquant les longueurs d’onde plus courtes (supérieures).

Contrairement aux filtres passe-bande qui ne laissent passer qu’une bande étroite de lumière, les filtres passe-long permettent de transmettre une gamme plus large de longueurs d’onde, filtrant efficacement les longueurs d’onde plus courtes.

Low Angle Lighting / Éclairage à faible angle

Technique d’éclairage où les objets sont éclairés sous un angle peu élevé par rapport à l’axe optique de la caméra, généralement autour de 45° hors axe.

Cette méthode crée des contrastes prononcés entre les éléments en relief et en retrait, facilitant ainsi la détection précise des défauts, l’évaluation de la qualité et les tâches d’inspection de surface.

Découvrez notre gamme d’éclairages Low Angle ici.

Luminous Flux / Flux lumineux

Mesure de la quantité totale de lumière visible émise ou rayonnée par une source lumineuse, quantifiée en lumens (lm).

Mm

Machine Learning

Sous-ensemble de l’intelligence artificielle (IA) qui implique le développement d’algorithmes et de modèles permettant aux systèmes informatiques d’apprendre et de faire des prédictions ou des décisions basées sur des données. Il englobe des techniques dans lesquelles les systèmes analysent et s’adaptent de manière répétée aux données, améliorant ainsi leurs performances au fil du temps.

Machine Vision / Vision industrielle

Terme très répandu désignant l’utilisation de composants matériels et d’algorithmes pour permettre aux machines (généralement des capteurs et des caméras) d’interpréter les informations visuelles de leur environnement.

L’utilisation de la vision industrielle est courante non seulement sur les lignes de production, mais également dans les applications liées au trafic et à l’espace, à l’agriculture et à de nombreux autres domaines.

Métrologie

La science de la mesure et de la précision. Dans le contexte de la vision industrielle, la métrologie fait référence à l’utilisation de technologies d’imagerie pour mesurer des objets et des surfaces avec précision dans une scène.

Multispectral Imaging / Imagerie multispectrale

L’imagerie multispectrale capture des informations sur quelques bandes de longueurs d’onde spécifiques, qui peuvent inclure la lumière visible et des parties sélectionnées du spectre infrarouge. Bien qu’elle fournisse des données spectrales moins détaillées que l’imagerie hyperspectrale, elle offre des informations précieuses sur les caractéristiques et attributs spécifiques des objets et des matériaux.

Nn

Neural Network / Réseau neuronal

Un type de modèle d’intelligence artificielle inspiré de la structure et du fonctionnement du cerveau humain. Ils sont constitués de nœuds interconnectés, ou « neurones », organisés en couches qui traitent et transforment les données. Les réseaux de neurones peuvent reconnaître des modèles, faire des prédictions et résoudre des problèmes complexes dans divers domaines, tels que la reconnaissance d’images et de la parole, le traitement du langage naturel et les tâches de prise de décision.

Oo

Objet

Fait référence à la partie ou au composant de la scène qui doit être analysé ou détecté.

Object Detection / Détection d’objet

La capacité d’un système de vision industrielle à identifier et localiser des objets dans une image.

Object Recognition / Reconnaissance d’objets

Capacité d’un système de vision industrielle à identifier et à classer des objets dans une image en fonction de modèles, de caractéristiques ou de critères prédéfinis.

OCR (Optical Character Recognition / Reconnaissance optique de caractères)

Logiciel dédié au traitement d’images de textes écrits dans un format compréhensible pour l’ordinateur. Il permet aux ordinateurs de reconnaître et d’extraire du texte à partir d’images, permettant ainsi un traitement et une manipulation efficaces des données.

OCV (Optical Character Verification / Vérification optique des caractères)

Technique utilisée pour vérifier l’exactitude des caractères ou symboles imprimés sur les produits. Les systèmes OCV garantissent que le texte ou les codes imprimés correspondent aux normes attendues.

Optical Filters / Filtres optiques

Dispositifs utilisés pour modifier le contenu spectral de la lumière en laissant passer certaines longueurs d’onde tout en bloquant d’autres. Les filtres peuvent être utilisés pour la correction de couleur, l’amélioration du contraste, etc.

OverDrive

Un réglage spécifique pendant lequel la source d’éclairage est momentanément alimentée avec une puissance supérieure à sa puissance nominale, afin d’obtenir une augmentation de l’intensité de l’éclairage pendant une courte période de temps.

Overfitting

Lorsqu’un modèle de Machine Learning apprend à fonctionner correctement sur les données d’entraînement mais ne parvient pas à se généraliser sur de nouvelles données. Pour le contraire, voir underfitting.

Pp

Part Localisation / Localisation de pièces

Identifier la position et l’orientation d’objets ou de pièces spécifiques dans une image. Cela est utile pour des tâches telles que les opérations robotiques de Pick and Place.

Pattern Recognition / Reconnaissance de formes

Capacité d’un système de vision industrielle à identifier et différencier des motifs ou des formes spécifiques dans une image, crucial pour identifier des objets ou des caractéristiques.

PCB

Printed Circuit Board (carte de circuit imprimé)

Photonique

Un domaine interdisciplinaire qui étudie la science et la technologie de la lumière.

La photonique dans la vision industrielle englobe le développement et l’application de dispositifs et de systèmes tels que les lasers, les leds, les lentilles et les capteurs.

Pick and Place

Processus de fabrication robotique qui implique la sélection (Picking) d’objets à un endroit et leur déplacement (Place) vers un autre endroit, souvent avec précision et rapidité. En intégrant des systèmes de vision industrielle, ces processus acquièrent la capacité de percevoir visuellement les objets, leurs positions et leurs attributs, permettant une prise de décision adaptative et un placement précis.

Pixel

La plus petite unité d’une image, représentant un seul point de couleur ou des informations en niveaux de gris.

Polarisation

L’orientation des ondes lumineuses dans une direction spécifique au sein d’une onde électromagnétique. L’éclairage polarisé est un éclairage dans lequel les oscillations du champ électrique se produisent principalement dans un seul plan.

Filtre de polarisation

Un filtre conçu pour améliorer la qualité et la visibilité de l’image en réduisant l’éblouissement, les reflets et la lumière indésirable dans les scènes présentant différents niveaux de réflectivité.

Il y parvient en laissant passer sélectivement certaines ondes à travers le filtre tout en bloquant les autres.

Process Interface / Interface de processus

Communication et lntégration entre le système de vision industrielle et d’autres composants ou processus au sein d’une configuration de fabrication ou d’automatisation plus large (par exemple, API, capteurs, contrôle de processus).

QR Code

Un code-barres matriciel bidimensionnel qui code les informations sous forme de carrés noirs et blancs. Il est couramment utilisé pour stocker des données telles que des URL, du texte ou autres informations qui peuvent être rapidement analysées et lues par des appareils dotés de caméras ou de lecteurs de code.

Les QR codes sont visuellement plus complexes que les codes datamatrix, avec un motif carré distinct comportant des marqueurs d’alignement. Cette conception permet de scanner les QR codes sous différents angles et même s’ils sont partiellement masqués ou endommagés.

Rr

Réflexion (reflets)

Processus par lequel la lumière qui atteint une surface est renvoyée ou redirigée dans différentes directions. L’angle sous lequel la lumière est réfléchie dépend de l’angle d’incidence et des propriétés de la surface elle-même.

La réflexion est un aspect crucial de la vision industrielle, car elle peut être utilisée pour capturer des informations sur les caractéristiques de surface, qui peuvent être utiles dans les tâches d’analyse de texture et de positionnement/alignement. Cependant, si elles ne sont pas correctement gérées, les reflets peuvent provoquer des points chauds (hot spots) et des éblouissements, interférer avec des mesures précises, réduire le contraste et même conduire à de faux défauts.

Réfraction

La courbure de la lumière lorsqu’elle traverse différents matériaux avec des indices de réfraction variables. Cela se produit lorsque la lumière passe d’un milieu à un autre et que sa vitesse change, provoquant une courbure des rayons lumineux à la frontière entre les deux milieux.

Rémission

Ratio entre la lumière qui atteint une surface et la lumière réfléchie par celle-ci. Il s’agit d’une mesure de la quantité de lumière réfléchie par un objet par rapport à la quantité de lumière qu’il reçoit. La rémission, également appelée réflectance, est souvent exprimée en pourcentage ou en valeur comprise entre 0 et 1, où 0 représente une absorption complète (pas de réflexion) et 1 représente une réflexion complète (pas d’absorption).

RGB / RVB

Modèle de couleur utilisé pour les écrans, les caméras et l’éclairage, dans lequel les trois couleurs primaires (rouge, vert, bleu) sont utilisées pour représenter et capturer les informations de couleur. En combinant différentes intensités de ces trois couleurs primaires dans chaque pixel, une large gamme de couleurs peut être affichée et analysée.

Ring Lighting / Éclairage annulaire

Positionnement d’une source lumineuse circulaire, le plus souvent en forme d’anneau, autour de la caméra. Il fournit un éclairage uniforme dans toutes les directions, réduisant les ombres et les reflets, ce qui le rend idéal pour des tâches telles que la capture de textures et de finitions de surface.

Apprenez-en davantage sur les annulaires ici.

Rolling Shutter / Obturateur déroulant

Fonction de capteur de caméra qui capture l’image en balayant la scène de façon séquentielle, ligne par ligne, plutôt que de capturer l’intégralité de l’image simultanément.

Ce processus de numérisation introduit un délai entre l’exposition des parties supérieure et inférieure de l’image. Par conséquent, dans les scènes en mouvement rapide ou lors de la capture de sujets changeant rapidement, l’obturateur déroulant peut entraîner une distorsion connue sous le nom de « rolling shutter effect ». Cet effet devient visible lorsque les objets ou éléments de la scène sont en mouvement pendant l’exposition. En revanche, un obturateur global (global shutter) capture simultanément l’intégralité de l’image.

Ss

Scène

Fait référence à la zone ou à l’environnement spécifique observé ou analysé par le système de vision. Il englobe tous les objets, composants et fonctionnalités présents dans le champ de vision de la caméra ou du système d’imagerie.

Scheimpflug

Fait référence au principe de Scheimpflug : une règle géométrique qui décrit l’orientation du plan de focalisation d’un système optique (comme une caméra) lorsque le plan de l’objectif n’est pas parallèle au plan de l’image.

Segmentation

Diviser une image en régions distinctes en fonction de certains attributs, facilitant la détection et l’analyse des objets.

L’objectif principal de la segmentation est de séparer les objets ou les zones d’intérêt de l’arrière-plan et les uns des autres, permettant ainsi une analyse plus ciblée et plus précise des composants individuels d’une image.

Sensor Size / Taille du capteur

Les dimensions physiques du capteur de la caméra, affectant le champ de vision et la qualité de l’image.

SMD

Surface-Mounted Device (Appareil monté en surface) Fait référence aux composants électroniques conçus pour être montés directement sur la surface d’une carte de circuit imprimé (PCB) sans fil.

Spectral Range / Gamme spectrale

La gamme de longueurs d’onde qu’une caméra ou un capteur peut détecter. Il détermine quels types d’éclairage, comme la lumière visible, ultraviolette ou infrarouge, le système peut capturer.

Spot Lighting / Éclairages Spot

Technique d’éclairage qui consiste à diriger un faisceau de lumière concentré et focalisé sur un point ou une région d’intérêt spécifique dans une scène ou un objet.

Parmi les applications, on trouve la mise en évidence de certaines caractéristiques pour une inspection détaillée, la lecture de textes et de codes-barres, le guidage de tâches d’alignement et de positionnement, la détection d’objets étrangers, la reconnaissance et la manipulation précise d’objets par le biais de robotique guidée par la vision.

Apprenez-en davantage sur nos spots ici.

State of Motion / État de mouvement

La configuration d’un objet ou d’un système concernant son mouvement ou son déplacement. Il englobe des caractéristiques telles que la vitesse, la direction, l’accélération et la position à un moment précis.

Stereo Vision / Vision stéréo

Technique d’imagerie 3D impliquant deux caméras ou plus pour capturer plusieurs perspectives de la même scène, permettant une estimation de la profondeur basée sur les disparités entre les points correspondants dans les images.

Strobe Mode

Mode de fonctionnement dans lequel la source lumineuse émet de courtes rafales d’éclairage intense avec un timing précis. Ces éclats de lumière sont synchronisés avec le temps d’exposition de la caméra, garantissant que le sujet n’est éclairé que lorsque la caméra prend effectivement une image. Le mode strobe est couramment utilisé pour figer le mouvement, réduire le flou de mouvement et améliorer la clarté des objets ou des scènes en mouvement rapide.

Structured Light / Éclairage structuré

Technique d’imagerie 3D utilisée pour capturer la forme tridimensionnelle d’objets ou de scènes. Cette technique fonctionne en projetant un jeu de lumière connu sur l’objet ou la scène, puis en analysant la façon dont ce motif se déforme en raison de la géométrie de la surface de l’objet.

Tt

Télécentricité

Fait référence à la propriété d’un objectif télécentrique de maintenir les rayons optiques parallèles à l’axe optique.

Thresholding

Technique de traitement d’image convertissant une image en forme binaire en classant les pixels en premier plan ou en arrière-plan en fonction de leur intensité.

Time-of-Flight (ToF)

En vision industrielle, le ToF fait référence à l’utilisation de capteurs qui mesurent le temps nécessaire à la lumière ou à d’autres signaux pour se déplacer de la caméra à un objet et revenir afin de déterminer la distance.

Les capteurs ToF sont utilisés dans diverses applications, telles que la technologie sur la ligne de but dans le football, les systèmes hawk-eye du tennis et les capteurs qui ont permis la création de la fonction 3D Google Maps.

Traçabilité

Capacité de suivre et d’enregistrer l’historique, l’emplacement et le mouvement des produits et des composants tout au long du processus de fabrication et de distribution à l’aide de techniques d’identification.

Transmission

Processus par lequel la lumière traverse une surface sans être absorbée ou réfléchie de manière significative. Lorsque la lumière rencontre un matériau transparent ou translucide, une partie de celle-ci peut être transmise. La quantité de lumière transmise dépend des propriétés du matériau, (telles que son épaisseur) et de la longueur d’onde de la lumière.

Uu

Ultraviolet (UV)

Forme de rayonnement électromagnétique dont les longueurs d’onde sont plus courtes que la lumière visible, allant généralement d’environ 10 nanomètres (nm) à 380 nm.

La lumière UV est invisible à l’œil humain mais a de nombreuses applications en vision industrielle, notamment l’inspection par fluorescence, la vérification des marques de sécurité et des timbres fiscaux, l’inspection des surfaces et la détection de contamination.

La lumière UV est classée en trois catégories : UVA (315-400 nm), UVB (280-315 nm) et UVC (100-280 nm).

Underfitting / Sous-ajustement

Lorsqu’un modèle de machine learning est trop simple pour capturer les modèles sous-jacents dans les données. Contrairement à l’overfitting, l’underfitting entraîne de mauvaises performances à la fois sur les données d’entraînement et sur les nouvelles données.

Ww

Wavelength / Longueur d’onde

La distance spatiale entre les crêtes (ou creux) successives d’une onde électromagnétique. La longueur d’onde de la lumière détermine sa couleur et le type de rayonnement qu’elle représente.

La lumière visible se situe dans une plage de longueurs d’onde allant de 380 à 780 nanomètres (nm), le spectre ultraviolet couvrant les longueurs d’onde inférieures à 380 nm et le spectre infrarouge englobant les longueurs d’onde supérieures à 780 nm.

Distance de travail

Distance (généralement exprimée en mm) entre l’objectif de la caméra ou le capteur d’image et l’objet inspecté ou imagé.

Il peut également faire référence à la distance entre l’objet et la source lumineuse. Il est rare dans les applications de vision industrielle que la caméra et la lumière soient positionnées à la même distance de travail.